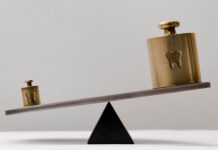

L’intelligenza artificiale nasce per stare al fianco dell’uomo o per sostituirsi a lui?

La parabola di Meredith Whittaker, inserita da TIME quest’anno nella classifica delle cento persone più influenti al mondo in materia, è illuminante. Fondatrice di Google Open Research, nel 2019 lascia il colosso del web divenuta attivista per i diritti umani, testimonia alle commissioni governative USA i percorsi controversi che i sistemi di AI possono imboccare nei loro processi decisionali, enfatizzandone le potenzialità perverse, criticando l’uso che i grandi motori di ricerca fanno dei nostri dati personali, quel “capitalismo di sorveglianza” che consente di produrre big data e rivenderli agli stessi inserzionisti che poi con l’AI sostituiscono il fattore umano in campi dove finora era considerato insostituibile. Poche settimane fa l’Unione Europea ha approvato il primo pacco di normative sull’intelligenza artificiale. Proprio nel giorno in cui veniva reso noto il primo licenziamento in Italia di tre giornalisti di una casa editrice internazionale, sostituiti da una macchina, Commissione, Consiglio e Parlamento hanno trovato un accordo per gridare forte che l’Europa – a differenza di USA, Cina, Giappone – non si accontenta dei codici etici di Google e Chat GPT, e per appellarsi a una sorveglianza umana. Bruxelles chiede che siano specificati i materiali usati per l’addestramento degli algoritmi; tutti i contenuti prodotti dall’AI vanno dichiarati al fruitore per evitare truffe o assoggettamento a “fake news”. In ambiti a rischio come la sanità (ma anche lavoro, formazione, immigrazione, giustizia), i 27 stati membri rivendicano la supervisione umana, un processo di technology assessment, diritti per i pazienti. Del resto anche Elon Musk, uno dei più grandi investitori nell’AI, ravvisa pericoli quando cita sistemi che con un paio di dati individuali, immagini, scritture, voci, costruiscono avatar in 3D di qualsiasi persona della quale questi dati sono disponibili, aprendo la porta a sostituzioni d’identità. Peraltro, gli stessi sistemi, gestiti eticamente, possono aprire nuovi orizzonti di salute – ad esempio nella telemedicina e in teleodontoiatria – nelle aree più remote del mondo.

L’AI Act europeo appare vicino alle posizioni di fondo dell’Organizzazione Mondiale della Sanità che questa estate ha emanato due documenti. Il primo: Ethics and Governance of Artificial Intelligence for Health si appella agli stati membri per non creare disparità d’accesso alle cure. È noto un errore compiuto da un sistema di AI statunitense che stimava il rischio sanitario di oltre 200 milioni di americani sulla base della spesa media individuale dimenticando che i pazienti afro-americani avendo meno disponibilità accedevano meno alle cure. Il secondo, Regulatory Consideration On AI For Health, (link) detta sei regole più una per certificare non solo la macchina ma anche la qualità dei dati. UE ed OMS credono che l’uomo possa domare le possibili fughe in avanti di questa forma di evoluzione, che si dice nel 2045 potrebbe superare il quoziente intellettivo dell’essere umano più intelligente.

E l’odontoiatria cosa fa? FDI sulla scia dell’OMS in un paper ha chiesto che i sistemi di AI favoriscano l’accesso alle cure dando risposte comprensibili e utilizzabili allo stesso modo in tutti i paesi dove sono utilizzati (link). Ma poco ha affrontato il nodo dei dati con cui i sistemi sono alimentati, il “chi controlla il controllore”. Rispetto alla medicina l’odontoiatria può precorrere i tempi: nel settore dentale l’AI è alimentata più con immagini e referti che con dati amministrativi e le nuove tecnologie si sviluppano rapide. I sistemi AI crescono negli atenei dove addestrano gli studenti, nell’imaging, nel 3D, nel fabbricare strumenti. Se i dati usati per addestrarli fossero imparziali e l’algoritmo adeguatamente “istruito”, potremmo davvero guardare all’intelligenza artificiale come ad uno strumento supplementare per ridurre il carico di lavoro e migliorare la precisione e l’accuratezza nella diagnosi, nelle decisioni, nella pianificazione di trattamenti, nella previsione dei risultati, nella prognosi della malattia. Ma le perplessità prevalgono. Secondo un’indagine pubblicata a febbraio su Frontiers in Dental Medicine (link), il 67% degli Odontoiatri ha dei dubbi sulla privacy e la sicurezza dei dati dei pazienti; una percentuale uguale non si fida dei sistemi e della loro accuratezza. Il 52% mette in questione l’etica dell’AI, il 43% teme gli alti costi che l’attuazione richiede e il 33% è convinta che l’AI li possa sostituire. E i pazienti? Pur convinti che l’AI ben gestita porti vantaggi, il 72% degli intervistati in una ricerca europea su Head & Face Medicine (link) lamenta la mancanza dell’interazione umana; il 66% non si fida dell’accuratezza dei sistemi AI, il 47% crede che i costi aumenteranno, il 35% non crede nel rispetto di privacy e sicurezza dei dati e il 34% ha dei dubbi sull’etica di produttori e prodotti.

L’AI rischia di sostituirsi al dentista e di progettare al posto suo allineatori, protesi, faccette. In assenza di regole (improbabili se gli stati non ascolteranno le organizzazioni internazionali né i ricercatori e i “visionari” che abbiamo citato) si rischia un’odontoiatria senza clinica, una medicina senza medico, una salute che non vede il malato e lo progetta senza conoscerlo. Con miriadi di implicazioni giuridiche, legali e sul futuro della salute del genere umano. Certo, pure la dinamite e l’energia atomica non erano pensate per distruggere o per nuocere. A maggior ragione, perché si realizzino le migliori intenzioni di chi pensa ai benefici per l’umanità, le innovazioni vanno gestite a mente fredda, con grande responsabilità sociale. E vanno tenute lontane dalle logiche di profitto.